ジャーナリストのマリアン・ロサドがインスタグラムのアカウントを閲覧していたとき、静かな日曜日、突然、珍しいインスタグラムのライブ配信に遭遇した。

著名な婦人科医のミリアム・アル・アディブ氏は、非常に個人的で衝撃的な状況を明かした。14歳の娘が、誰かがアプリを使ってソーシャルメディアから写真を撮り、裸に見せかけたと言ったのだ。

これはスペイン南部の静かな町に注目を集めたスキャンダルの始まりに過ぎない。

今後 3 つのエピソードにわたって、Euronews Tech Talks のチームが AI ディープフェイク テクノロジーの世界を掘り下げていきます。

私たちはその範囲を明らかにし、そのリスクを軽減する戦略に取り組み、危険を認識して身を守るよう社会を教育する方法を探ることを目指しています。

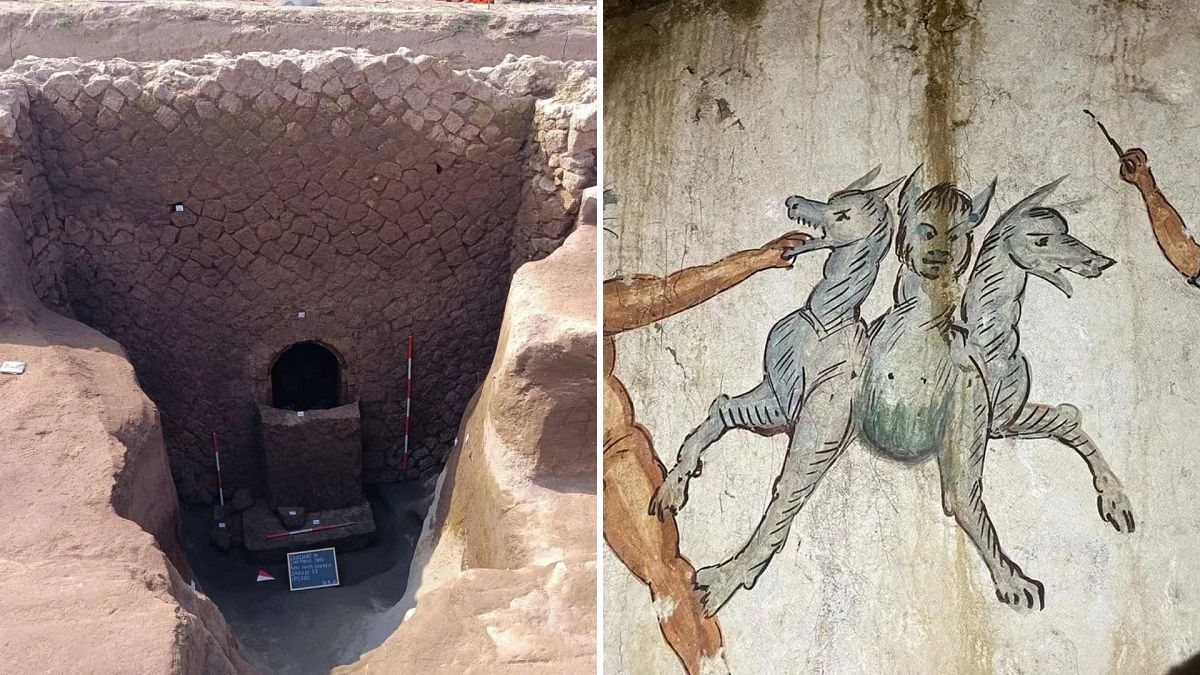

アルメンドラレホは、ポルトガル国境に近いスペインのエストレマドゥーラ州に位置する人口 35,000 人の静かな町ですが、通常、国内はおろか国際的な注目を集めるような場所ではありません。

ところが、学校が休み明けの9月に、アルメンドラレホが見出しを飾った。

地元の十代の若者数十人が、AIが生成した自分たちの裸の画像を携帯電話で受け取ったと報告した。

実際の写真では、十代の若者たちは完全に服を着ていました。これらの画像はInstagramアカウントから盗まれ、人工知能(AI)アプリを使って改変され、WhatsAppグループ内で拡散された。

ヌードの人工的な性質にもかかわらず、母親が報告したように、これらの画像を見たときに少女たちが感じた苦痛は非常に現実的でした。

この物語をさらに不安にさせるのは、このセクハラの加害者も少女たちの知っている十代の若者たちだったということだ。

「AIでどんな写真も無料で脱がせる」

同様に不安なのは、これらの画像がいかに簡単に作成されたかということです。

AI を利用した合成メディアの一種であるディープフェイクには、通常、ディープラーニングなどの複雑なプロセスが含まれます。

ただし、これらのティーンエイジャーは AI の専門家ではありませんでした。彼らは、Clothoff アプリを使用して、単純に 10 ユーロを支払って、同僚の超リアルな裸の画像 25 枚を入手しました。

無料でダウンロードできるこのアプリは、「AI でどんな写真も無料で脱がせる」というスローガンを掲げ、携帯電話の写真ギャラリーにある誰でもデジタル的に服を脱ぐことができます。

ルールの説明を求められた際、クロスフ氏は年齢確認と同意の取得を強調した。

彼らは年齢確認を真剣に受け止めていると主張したが、「セキュリティ上の理由」によりその方法は明らかにしなかった。

同意に関して、彼らは厳格なポリシーがあると主張したが、それを明示せず、ユーザーがガイドラインに従うことに依存していた。

Sensity AI の調査により、ディープフェイク画像の 96% が、同意のない女性の露骨な性的写真で構成されていることが明らかになりました。

ユーロポールの報告書では、3 年以内にオンライン コンテンツの約 90% が AI によって生成される可能性があると推定しています。